Meta新模型TRIBE v2|免掃描測神經反應

原文刊於信報財經新聞「CEO AI⎹ EJ Tech」

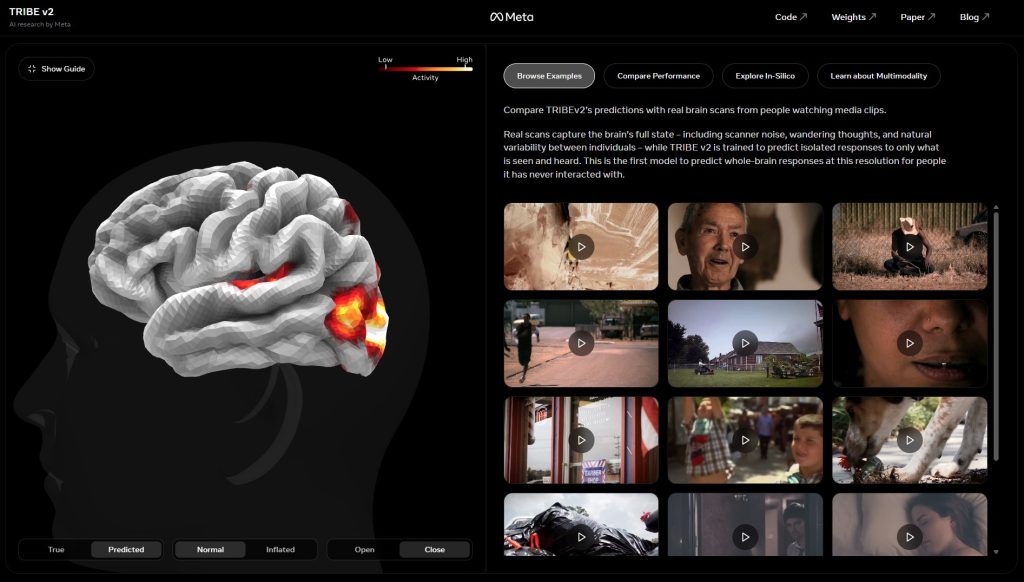

神經科學幾十年來一直面臨一個重大樽頸,就是每項研究都要重新測量實驗志願者的腦部反應數據,令科學界對大腦機制的理解變得緩慢且昂貴,並且難以規模化及整合。Meta基礎人工智能研究團隊(FAIR)發布預測基礎模型TRIBE v2,利用人工智能(AI)而毋須掃描志願者腦部,便可預測人腦對視覺、聽覺及語言刺激的神經反應。

TRIBE v2模擬大腦活動

TRIBE v2模型基於720名健康志願者的龐大數據集,超過1000小時的「功能性磁振造影」(fMRI)資料訓練而成,分析不同腦區活動的血流及氧氣水平。志願者在掃描期間觀看影片、收聽播客、瀏覽圖片及閱讀文字,模型從中學習大腦對不同刺激的反應模式。跟前代產品TRIBE v1相比,TRIBE v2速度更快、精度更高,模擬大腦活動的解像度提高70倍。

更重要的是,TRIBE v2支持電腦模擬實驗,具備「零樣本預測」(Zero-shot Prediction)能力,即不必重新訓練模型,便可預測新個體、新語言,以及完全不同任務的腦部反應,恍如建立「神經活動的數碼孿生」。Meta已開源論文、程式碼庫、模型權重及演示程式,有助推動神經科學、人工智能(例如腦機介面開發),以及腦部疾病的治療研究。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

Related Posts

Latest News

-

馬斯克「痛苦」預言 時代試煉(方保僑)

最近科技界最熱門的話題,莫過於特斯拉(Tesla)掌舵人馬斯克(Elon Musk)對2026年的驚人預測。

- Posted March 30, 2026

- 0

-

戴智能眼鏡上庭 礙司法公正(郝本尼)

英國倫敦高等法院不久前爆出荒謬一幕,事緣某宗商業案件原告出庭作證期間,法官發現這位證人回答問題時多次停頓,傳譯員與辯方律師更聽到干擾訊號,結果揭發他利用智能眼鏡連接手機通話。

- Posted March 30, 2026

- 0

-

AI用途調查|美民眾僅13%放心坐自駕的士

哥倫比亞廣播公司新聞(CBS News)夥拍民調網站YouGov,今年3月16日至19日調查2500位美國成年人,發現受訪者樂於讓人工智能(AI)去做的事情,往往是冷冰冰甚至枯燥的任務,首選網上搜尋(70%)及校對文件(64%)。

- Posted March 30, 2026

- 0

-

Meta新模型TRIBE v2|免掃描測神經反應

神經科學幾十年來一直面臨一個重大樽頸,就是每項研究都要重新測量實驗志願者的腦部反應數據,令科學界對大腦機制的理解變得緩慢且昂貴,並且難以規模化及整合。

- Posted March 30, 2026

- 0

-

whoami.wiki|乖孫用AI為祖母建維基專頁

whoami.wiki是一款人工智能(AI)百科全書工具,專案創辦人菲洛門(Jeremy Philomen)利用AI代理,整合個人數碼檔案(照片、聊天記錄、文件等),為祖母創建私家《維基百科》頁面,記錄她的一生。

- Posted March 30, 2026

- 0

-

思科專訪|倡統一平台 助港企AI治理 內部基建未完備 乏監察工具

人工智能(AI)浪潮席捲全球,港企同樣不甘後人,陸續引入AI工具、重塑業務,但內部是否真的準備好迎接這場轉型,卻是另一回事。

- Posted March 30, 2026

- 0

-

AI代理做實事 重寫人機分工(林國誠)

過去一年,人工智能(AI)最值得關注的變化,不在語言更流暢或答案更準,而是開始實際幫你做事,這正是被稱為代理式AI(Agentic AI)的新方向。它不再只是資訊回應器,而是任務推進者。你給它一個目標,它懂得先理解意圖,再拆解步驟,在多個工具之間協調執行,直到任務完成。

- Posted March 27, 2026

- 0