開源大型語言模型更多選擇:從封閉API到百花齊放的AI新時代(吳壽冠)

本文作者吳壽冠先生(Ivan Ng)是數據及人工智能素養協會(Data and AI Literacy Association, DALA)資深創會會員兼Lively Impact創辦人及行政總裁,同時是心理學碩士及研究人員。

人工智慧的發展,特別是大型語言模型(LLM),正以驚人的速度重塑我們的世界。然而,回溯不久前的歷史,這個尖端領域的權力相對集中。以OpenAI開發的GPT系列為例,從具備強大文本生成能力的GPT-3到更為先進的GPT-4,儘管其效能震撼全球,但其核心模型始終是「閉源」的。開發者和企業僅能透過API(應用程式介面)付費使用,無法一窺模型內部結構,更遑論進行底層修改或私有化部署。同樣,由X(原 Twitter)推出的 Grok 在初期也是以預覽版形式提供給特定用戶,延續了這股閉源的潮流。

這種模式雖然有助於商業化和控制技術的應用,卻也築起了一道高牆,限制了學術研究的深度、新創公司的創新彈性,以及對數據隱私有嚴格要求的企業。然而,一股強大的開源力量正在迅速崛起,徹底改變了這個由少數巨頭主導的局面。

開源的黎明:Meta LLaMA 與 DeepSeek 的破局

開源運動的轉捩點,始於2023年2月,Meta決定向研究界發布其大型語言模型LLaMA。儘管最初的授權並非完全開放商業使用,但其卓越的性能證明了開源模型足以媲美頂尖的閉源對手。這項舉動極大地激勵了全球的開發者社群。隨後,Meta推出的LLaMA 3系列,以更開放的授權和更強的性能,正式引爆了開源LLM的浪潮。

2025年初,來自中國的深度求索(DeepSeek)也迅速成為開源領域的一支重要力量。他們持續推出一系列高品質的開源模型,特別在程式碼生成和邏輯推理方面表現出色,贏得了開發者的廣泛讚譽。

Meta與DeepSeek等先驅者採用的「開放權重」(Open Weight)模式,是這場革命的核心。這意味著他們不僅公開了模型的架構,更將訓練完成的「模型權重」(即模型學習到的知識)公之於眾。這帶來了幾個關鍵性的好處:

- 本地部署(Local Deployment): 企業和個人開發者可以將模型下載到自己的伺服器甚至個人電腦上運行。這不僅能大幅降低對雲端API的依賴和成本,更能確保數據完全在內部處理,徹底解決了數據隱私和安全性的疑慮。

- 深度客製化(Deep Customization): 開發者可以在開源模型的基礎上,使用自己的數據進行微調(Fine-tuning),打造出最適合特定行業或特定任務的專有模型,這是封閉API無法提供的彈性。

- 推動AI發展: 全球的研究人員和開發者都能夠存取和研究這些最先進的模型,加速了技術的迭代、創新和普及,形成了一個良性循環的創新生態系統。

蒸餾模型:讓多元生態系統綻放

隨著基礎開源模型的普及,一個更為豐富的生態系統應運而生。開發者們不再滿足於單一的龐大模型,而是開始探索如何使其更輕量、更高效。於是,「蒸餾模型」(Distilled Models)的概念應運而生。

蒸餾,如同其名,是將一個龐大、複雜的「教師模型」的知識,萃取並「蒸餾」到一個更小、更精簡的「學生模型」中。這樣做的好處是,學生模型雖然參數規模小得多,卻能繼承教師模型大部分的關鍵能力,同時運行速度更快、對硬件資源的要求更低。

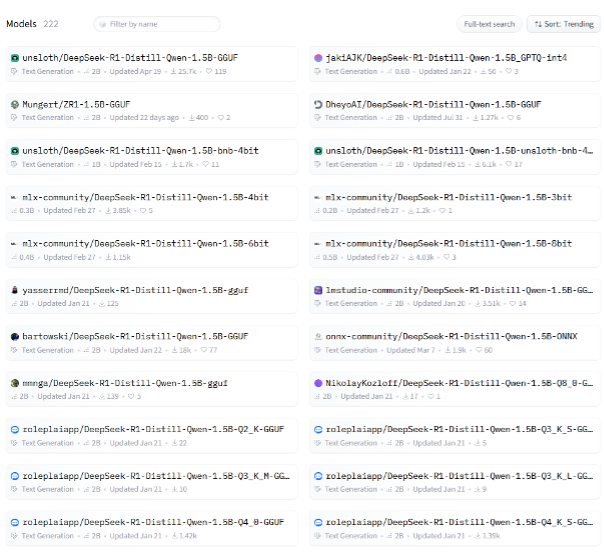

在Hugging Face(全球最大的AI社群和模型託管平台)上,你可以找到數以萬計的模型。以DeepSeek為例,除了官方發布的基礎模型外,社群中還湧現出數十個甚至上百個由其蒸餾、微調而來的版本,它們有些專精於特定語言,有些則為特定任務(如對話、摘要)進行了優化,真正實現了AI模型的「豐儉由人」。

百花齊放:這一年,我們迎來的開源新選擇

過去一年,開源LLM的發展進入了快車道,更多重量級選手的加入,為使用者提供了前所未有的豐富選擇。

- Qwen(通義千問): Qwen是由阿里巴巴達摩院推出的模型。Qwen模型家族非常完整,從數十億參數的輕量級模型到數千億參數的巨無霸一應俱全。其最大的優勢之一是其出色的多語言能力,尤其在中文處理上具備原生優勢,同時也支援多種主流語言,為全球用戶提供了可靠的選擇。

- OpenAI GPT-OSS: 這無疑是開源界的一件大事。昔日閉源模式的領航者OpenAI,竟也調轉船頭,發布了其自GPT-2以來的首個開源權重模型系列GPT-OSS。此系列包含兩個不同規模的模型,採用了先進的「專家混合」(Mixture-of-Experts, MoE)架構,旨在以更低的計算成本實現頂尖的推理能力。這一舉動被視為OpenAI對開源社群力量的認可,也為市場帶來了具備頂級血統的開源新星。

- DeepSeek-V3.1: 作為開源領域的持續貢獻者,DeepSeek的最新力作V3.1展現了開源模型日益增長的複雜性和智慧。它引入了創新的「混合推理」模式,能夠在需要深度思考的「Thinking Mode」和追求快速回應的「Non-thinking Mode」之間切換。這使得單一模型能同時應對需要嚴謹邏輯推導的複雜任務,以及需要即時反應的對話場景,極大地拓寬了模型的應用範圍。

- Seed-OSS: 來自字節跳動(ByteDance)的開源模型Seed-OSS 能夠處理業界領先的 512k 超長上下文,其能力是目前主流模型的四倍,甚至達到 GPT-5 的兩倍,相當於一次性處理超過 1600 頁的文本內容。這項能力並非透過後續擴展實現,而是在預訓練階段就以海量數據進行了原生訓練,確保了處理長篇內容時的穩定性與高效性。此外,模型還引入了「思考預算」(Thinking Budget)功能,允許開發者根據任務需求,靈活地控制模型的思維鏈長度,進而有效管理推理成本並最佳化應用體驗。Seed-OSS 系列的出現,標誌著開源領域的競爭已從單純追求性能指標的「比大比強」,擴展到關注實際應用中成本效益與效率的「比巧比省」階段。這也體現了業界正積極探索如何讓強大的 AI 技術以更高效、更經濟的方式落地應用。

開源與閉源的抉擇:簡單比較

儘管開源大語言模型選擇較多,但不同企業的需求亦非常多元化,以下開源與閉源的差異比較表格希望可為你的選擇提供一些幫助:

一個更加開放和去中心化的AI未來

從GPT-4的API高牆,到如今Llama 3、Qwen、GPT-OSS、Seed-OSS等眾多模型的百花齊放,大型語言模型的發展格局在短短時間內發生了根本性的轉變。開源,不再是「次等」或「實驗性」的代名詞,而已成為一股與閉源模式並駕齊驅,甚至在某些方面更具活力的核心力量。

這場開源革命的意義遠不止於提供免費的工具。它正在將AI的能力從少數科技巨頭手中,釋放到成千上萬的開發者、研究人員和企業手中,催生一個更加公平、透明、去中心化的創新生態。對於追求數據主權、業務彈性和成本效益的企業而言,開源LLM無疑開啟了一扇通往無限可能的大門。未來,選擇哪條路,將不再是一個技術問題,而是一個關乎戰略、創新與自由的抉擇。

最後一提 :香港數據與 AI 界年度旗艦獎項—DALA Awards 2025 強勢回歸!把握最後機會!不論你是個人、中小企、企業或技術方案服務商,DALA Awards 2025 都歡迎行業翹楚參與。今年盛典旨在表彰參賽者於數據與 AI 創新及應用上的卓越成就,帶動行業前瞻發展。

立即參加,攜手推動數據與 AI 領域的創新及卓越:https://dalahk.org/2025-dala-awards/

更多吳壽冠文章:

- 什麼是Contextual Engineering,與Prompt Engineering有什麼不同?

- 像聊天一樣寫程式 – Vibe Coding是什麼?

- AI火熱技術-MCP(Model Context Protocol)模型上下文協定跟我們有什麼關係?

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。