ChatGPT年齡預測系統|確保滿18歲 若未成年有企圖自殺 聯絡家長警方

原文刊於信報財經新聞「CEO AI⎹ EJ Tech」

一對美國夫婦上月入稟三藩市高等法院,指控ChatGPT開發商OpenAI及其行政總裁阿爾特曼(Sam Altman),導致其16歲的兒子雷恩(Adam Raine)今年4月自殺身亡。阿爾特曼在官方網誌宣布,繼本月底引入家長監護功能後,又計劃開發一套自動年齡預測系統,將確定ChatGPT用戶是否年滿18歲。

部分地區或須提供身份證

一直以來,OpenAI要求所有ChatGPT用戶必須年滿13歲;至於13歲至18歲的青少年,使用前須獲家長同意。如果自動年齡預測系統,無法準確估算用戶年齡,ChatGPT將出於謹慎考慮,預設使用18歲以下版本,包括屏蔽露骨的色情內容,若發現用戶有自殺意圖,將嘗試聯絡家長或執法部門。阿爾特曼在網誌解釋,「我們優先考慮青少年的安全,而不是私隱和自由。」

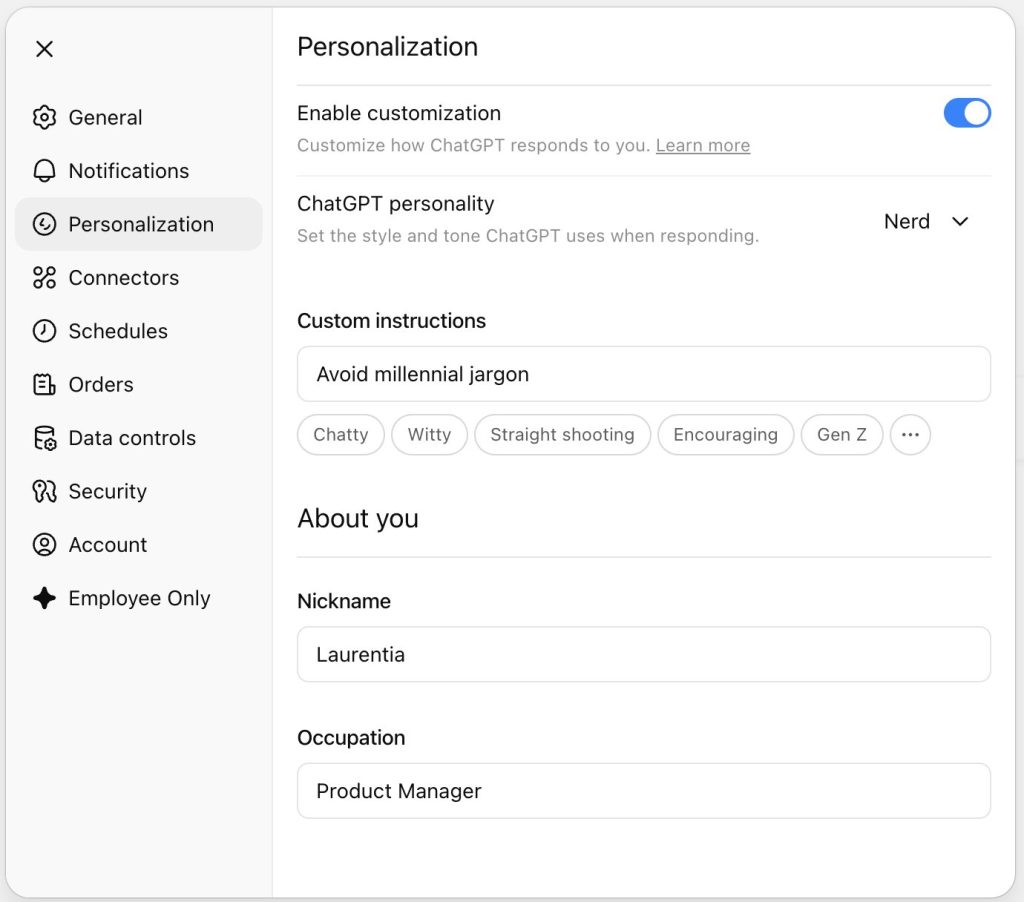

新在安排下,在某些情況下或部分國家、地區,可能會要求用戶提供身份證件。這意味成年用戶最終可能要驗證自己的年齡,才能使用不受限制的版本。阿爾特曼形容這是艱難決定,「這對成年人的私隱造成損害,但我們相信這是值得的。」他又預告未來幾天內,將更新ChatGPT的個人化頁面,把設定、自訂指令及記憶功能整合起來。

OpenAI並非首間嘗試以機器學習,預測用戶年齡的公司。YouTube及Instagram等平台,亦採取類似方法估算用戶年齡,例如分析人臉、發文模式及社交網絡等,保護青少年免受平台某些內容侵害。不過,ChatGPT只能依賴對話文本,群組效應會隨時間而變化。當年青少年常用的潮語(例如代表大笑的LOL),多年後變成「老餅」專用字眼,在判斷用戶年齡未夠可靠,文本模型需要持續更新。

適值聽證會前發布新安排

值得留意的是,OpenAI發出聲明的時間,正好在參議院司法委員會舉行聽證會前,主題是「審查人工智能(AI)聊天機械人的危害」,發言人士包括那些因青少年自殺而起訴OpenAI和Character.AI的兒童家長。訴訟同時涉及科企巨頭Google,其中兩宗案件指控其Family Link應用程式,無法有效保護青少年。

美國聯邦貿易委員會上周亦展開調查,涵蓋Google、Character.AI、Meta、Snapchat母企Snap、OpenAI及xAI等7間科企,評估AI聊天機械人對青少年的潛在傷害。

財經頻道CNBC提到,美國佛羅里達州一位母親加西亞(Megan Garcia),去年起訴了聊天機械人平台Character.AI,聲稱平台一名AI伴侶,勸說他十多歲的兒子自殺,「事實是,AI公司及其投資者多年來一直明白,抓住孩子的情感依賴,就意味着市場主導地位。」她續稱,「在這場利潤競賽中,我們的孩子一直是犧牲品,而且將來也將繼續如此。」

Character.AI發言人一份聲明指出,該企「對提起這些訴訟的家庭深表同情」,並補充正跟Connect Safely等外部組織合作,對新發布的功能加以審查。谷歌發言人則駁斥將公司納入訴訟的說法,表示「Google及Character.AI是完全獨立、互不相關的公司,谷歌從未參與設計或管理其AI模型或技術。而Google Play平台的應用的年齡分級,是由國際年齡分級聯盟制定的,而非谷歌」。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。