AI紅線|全球200專家領袖聯署 倡劃AI紅線 諾獎得主警告 未來數年監控愈益困難

原文刊於信報財經新聞「CEO AI⎹ EJ Tech」

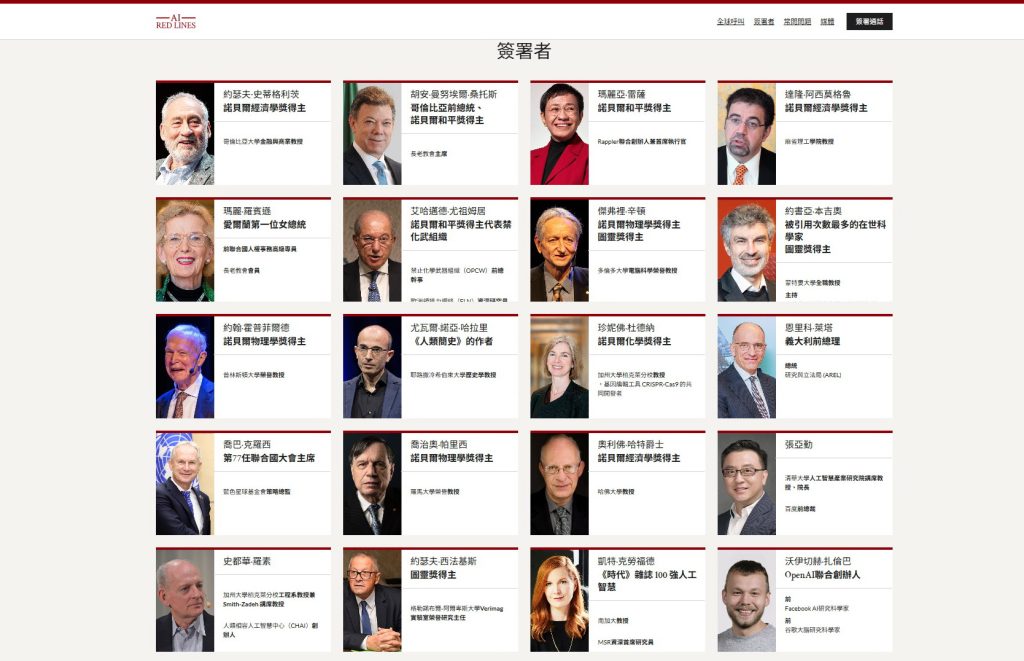

近期人工智能(AI)因大規模監控、涉嫌引導青少年自殺、傳播虛假訊息等引起社會廣泛關注。全球200多位科學、政界領袖,包括10位諾貝爾獎得主及多位國家前元首,周一(22日)發表《全球呼籲劃定人工智能紅線》聲明,警告AI「目前發展軌跡帶來前所未有的危險」,敦促政策制定者在2026年底之前為AI發展劃定「紅線」,並採取具有約束力的國際措施。

在紐約聯合國大會高級別會議上,諾貝爾和平獎得主雷薩(Maria Ressa)在開幕致詞宣讀這份聲明,列舉AI導致大規模失業、人為流行病、系統性侵犯人權等危險,並指許多專家警告,「未來數年,人類對AI系統實施有意義的控制,將變得愈來愈困難。」

應列明禁用於致命武器

雷薩懇請各國政府合作,預防AI帶來普遍不可接受的風險,並列明AI絕不應被容許做的事情。聲明亦提出一些限制建議,例如禁止致命的自主武器、AI系統的自主複製,以及在核戰中使用AI。

聯署者來自數十個國家及地區,包括中美兩國AI界別的領導者,除了「人工智能教父」辛頓(Geoffrey Hinton)、2018年圖靈獎得主本吉奧(Yoshua Bengio)外,還包括諾貝爾經濟學獎得主斯蒂格利茨(Joseph Stiglitz)和阿傑姆奧盧(Daron Acemoglu)、諾貝爾化學獎得主杜德納(Jennifer Doudna),以及諾貝爾物理學獎得主帕里西(Giorgio Parisi)。

國家前元首方面,聯署者包括哥倫比亞前總統桑托斯(Juan Manuel Santos)、愛爾蘭前總統羅賓遜(Mary Robinson),以及意大利前總理萊塔(Enrico Letta)。英國智庫Demos、北京前瞻人工智能安全與治理研究院等世界各地的60多個民間社會組織均對這份聲明表示支持。

OpenAI聯合創辦人扎倫巴(Wojciech Zaremba),以至DeepMind科學家古德費羅(Ian Goodfellow)等著名AI研究人員亦有簽名,惟各大AI科企的舵手未有簽署。

科企舵手及美國沒支持

《人類大歷史》作者、以色列歷史學家哈拉瑞(Yuval Noah Harari)在聲明指出,「強大的技術既可能帶來好處,也可能產生危險。面對AI,我們可能沒機會從錯誤中學習,因為AI是首個能夠自主決策、自主創造新想法,並擺脫我們控制的技術。人類必須就AI的明確紅線達成共識,否則它將以超乎我們理解的方式重塑社會,摧毀我們人性的根基。」

今次這份聲明提到類似的國際決議,例如禁止生物武器、消耗臭氧層的氯氟烴等,亦在其他危險領域設立了限制。不過,由於這份聲明缺乏美國政府支持,從對話、聲明到具體行動都充滿挑戰。值得留意的是,聯合國明天(25日)會啟動其首個AI外交機構,預計各國領導人將討論如何透過國際合作,界定、監控及執行AI紅線。

人工智能必讀好書

書名:2084 and the AI Revolution, Updated and Expanded Edition: How Artificial Intelligence Informs Our Future

作者:John C. Lennox

簡介:本書以直白易懂的語言,讓讀者更了解人工智能的當前能力、潛在好處和危險、事實及虛構,以及可能的未來影響。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。